Was haben Hunde mit KI zu tun? Wie können wir künstliche Intelligenz & Ethik vereinen? Und wo ist die goldene Mitte zwischen Skepsis und Euphorie bezüglich KI?

Künstliche Intelligenz als Konzept ist uns bereits seit den 50er Jahren bekannt. Doch erst in den letzten Jahre erlebt diese Technologie einen Hype. Von Skepsis bis zur Euphorie gibt es verschiedene Meinungen zur KI – besonders spannend für uns ist die Frage nach der Ethik. Letzte Woche habe ich mich mit drei anderen Liechteneckers zum AI Congress begeben, um neuen Input bezüglich KI zu erhalten. Hier eine Zusammenfassung vom Einleitungsvortrag von Christian Heilmann.

Self replicating genies – How to democratize and ensure ethics in AI

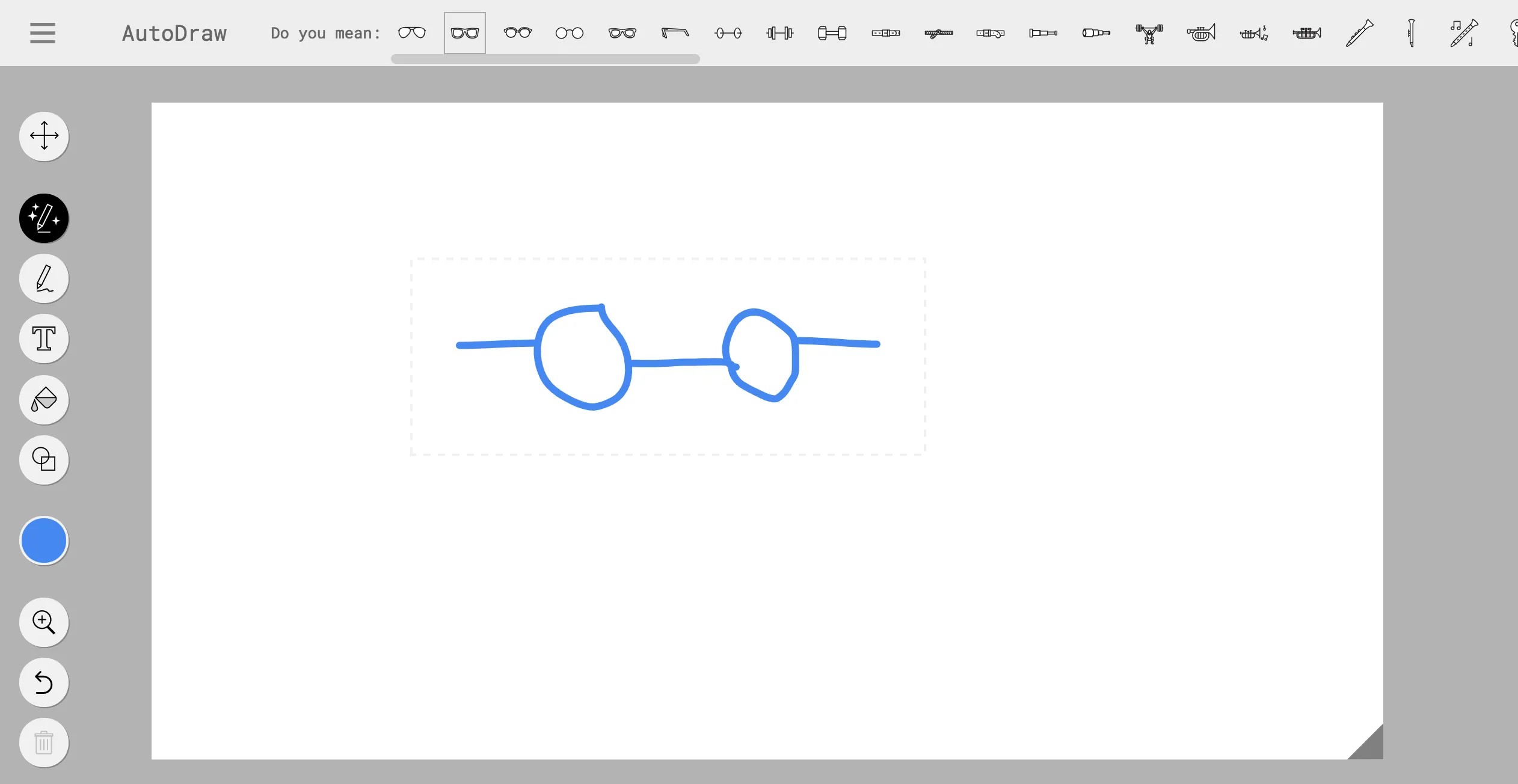

Christian Heilmann hat eine wahnsinnig spannende Liste an KI Projekten gesammelt, die du dir hier anschauen kannst. Diese Website schätzt dein Alter. Und hier ist ein Shy Blob, der nur dann tanzt, wenn du nicht hinschaust. Linda Liukas schreibt Hello Ruby Bücher, die Kindern das Internet, Computer und künstliche Intelligenz erklären. Autodraw hilft beim Zeichnen, indem es das Objekt erkennt und fertige Zeichnungen vorschlägt.

1. Unbegründete Angst vor KI = falsch

KI ist aktuell einer der wachstumsstärksten Märkte, meint Heilmann. Dieses Feld sei jedoch nichts, das nur Entwickler und Programmierer beschäftigen sollte. Vielmehr geht es darum, die richtigen Fragen zu stellen, die mit Daten beantwortet werden können. Damit beschäftigt KI auch Psychologen, Sozialwissenschaftler, Künstler, Designer und so viele mehr.

Viele Menschen sind besorgt darüber, dass Maschinen unsere Jobs wegnehmen werden. Das sei der Meinung Heilmanns nach unbegründet. KI wird nur die langweiligen Jobs übernehmen, die für den Menschen gar nicht so gut geeignet sind. Maschinen sind nämlich viel besser darin, mit großen Mengen an Daten umzugehen. Menschen sollen dafür bestimmen, WOFÜR Daten verwendet werden und WAS damit gemacht wird.

2. Blindes Urvertrauen in KI = falsch

So falsch, wie unbegründete Skepsis, ist auch blindes Vertrauen auf die Ethik und die Ignoranz gegenüber den Daten, auf denen KI Projekte aufbauen. „Ich habe nichts zu verbergen“, sagen Menschen oftmals, wenn man sie darauf hinweist, dass ihre Lieblingsnetzwerke Unmengen an Daten von ihnen sammeln und verwerten. Das sei dumm, meint Heilmann.

Vielmehr sollte man sich die Frage stellen, wie sich diese Persona, die aus den verfügbaren Daten von mir kreiiert wurde, von meinem wirklichen Ich unterscheidet. Überhaupt wird es in Zukunft viel mehr darauf hinauslaufen, dass wir die Daten, die Services und Seiten von uns sammeln, herunterladen und auch löschen werden können. Bzw. dass das eine gängige Praxis wird – zumindest wäre das eine der Möglichkeiten, die Ethik von KI zu gewährleisten.

Künstliche Intelligenz in Aktion: Autodraw hilft beim Zeichnen, indem es das Objekt erkennt und fertige Zeichnungen vorschlägt.

3. Künstliche Intelligenz ist nur so ethisch, wie ihre Daten

KI kann keinen kreativ denkenden Menschen ersetzen. Genauso wenig besitzt KI Moral oder Ethik. Intelligente Maschinen verarbeiten lediglich die Infos, die wir ihnen speisen.

Ist diese Info verzerrt oder voreingenommen, wird dieser Bias (= kognitive Verzerrung) unter Umständen nur verstärkt.

Ein Beispiel: Datensätze aus Wikipedia wurden in eine KI-Applikation eingespielt. Begriffe, die in den Datensätzen oft mit “er” (also männlich) verbunden waren, speichert die Applikation als männlich ab. So ergibt sich bei der Auswertung ein “voreingenommenes” Datenmodell und der Begriff Manager wird als männlich abgespeichert wobei der Begriff Putzkraft z.B. als weiblich vermerkt wird. Ein ähnliches System, das wohl auf verzerrten Daten basierte, stufte farbige Menschen öfter krimineller ein als weiße Menschen. Die Frage: Wie bekommen wir den Faktor der Vorurteile aus KI-Applikationen raus?

Begrenzte und verzerrte (oder halt vorurteilsbehaftete) Daten kreiieren schreckliche KI Ergebnisse. Deswegen sollte die Frage eher lauten: Wie bekommen wir den Faktor Vorurteile aus den Daten raus?

Linda Liukas schreibt Hello Ruby Bücher, die Kindern das Internet, Computer und künstliche Intelligenz erklären.

4. Mehr Transparenz ist die Zukunft

Künstliche Intelligenz kann ein hervorragendes Tool sein, um uns dabei zu helfen, weniger Fehler zu machen. Unsere physische Barrieren zu überwinden. Damit es jedoch richtig und nachhaltig funktionieren und gesellschaftlich akzeptiert werden kann, benötigt es Transparenz. Transparenz darüber, wofür die gesammelten Daten verwendet werden.

Ein großes Problem von fehlender Transparenz nennt man in der KI das Black Box Modell. Dieses sagt aus, dass nicht nachvollzogen werden kann, auf welchen Fakten welche Entscheidungen basieren – weil im Hintergrund einer KI keine simplen Abfragen wie “Wenn A, dann B” stattfinden. Die mathematischen Algorithmen hinter einer AI sind extrem komplex und vertieft. So kann man zwar ein Ergebnis bekommen, aber nicht die Gründe warum und wie es zu diesem Ergebnis kam.

Ein kleines Beispiel dazu: wir trainieren Hunde, damit sie Drogen, Sprengstoff oder Menschen finden. Stellen wir uns also vor, wir würden einen Hund so trainieren, dass er in Gerichtsfällen entscheidet, wer Recht und Unrecht hat. Angenommen, der Hund wäre richtig gut in seiner Aufgabe, dann dürfte er wohl als Richter fungieren. Also würde nun der Hund entscheiden, wer ins Gefängnis muss, und wer nicht. Wenn man ihn fragte, warum eine Person ins Gefängnis muss, so könnte er uns nichts antworten. Natürlich nicht. Er kann ja nicht reden. Aber im Grunde genommen ist der Hund nichts anderes als das KI Black Box Modell.

Die KI muss also einen Weg finden, um ihre Schlüsse und Entscheidungen offen zu legen und keine Black Box zu werden. Transparenz ist ein wichtiger Faktor, um akzeptiert und verstanden zu werden.

BONUS: Eröffnung durch Margarete Schramböck

Die Bundesministerin für Wirtschaftsstandort und Digitalisierung leitete den Kongress ein und teilte spannende Einblicke in die politische Seite der Thematik. Hier einige Zitate und Gedanken.

„Menschen, die im Technologiesektor arbeiten, sind sehr privilegiert. Das bringt eine große Verantwortung mit sich.“

Alle 250 Jahre erlebt eine Generation einen derartigen Wandel, dass sie von der vorhergehenden Generation kaum verstanden werden kann. Die Ministerin erzählt über die Ferien in ihrer Kindheit, in denen sie ohne Telefon, Fernsehen und jegliche weitere Verbindung zur Welt die Freizeit verbrachte, etwas das die heutige Generation an Kindern sich gar nicht mehr vorstellen kann.

„Technologie soll uns dabei helfen, das Leben EINFACHER zu gestalten.“

Nicht nur im Minsteriumstitel findet sich die Digitalisierung wieder, vielmehr wird sie Österreich für die nächsten Jahre stark beschäftigen. Mit Fokus auf die künstliche Intelligenz, betont Schramböck. Hier könnt ihr euch die Digitale Strategie der österreichischen Bundesregierung anschauen. Wir sind gespannt auf die kommenden Entwicklungen & freuen uns, darin eine aktive Rolle einzunehmen.

Du willst mit jemanden über das Thema plaudern?

Jetzt gleich eine E-Mail schreiben!Behind the scenes: Ein Barrierefreiheits-Audit

”Entspricht unsere Website den gesetzlichen Anforderungen und wenn nicht, was genau müssen wir ändern?” Diese Frage lieben wir. Echt! Und so sieht unsere Antwort aus.

Jetzt lesenEpisode #9 mit Oliver Schöndorfer

In dieser Folge zieht uns Oliver mit seinem unbändigen Enthusiasmus in die Welt der Schriften hinein. Jede Website schaut mittlerweile gleich aus? Keine Ausrede mehr; die Schrift ist die Stimme deiner Marke, mach was draus!Willkommen zum [...]

Jetzt anhören